こんにちは.富士通研究所人工知能研究所のプライニング ノルベルトと小橋博道です。 2月の8日から10日にかけて、Scikit-learnコンソーシアム主催のワークショップ(Interpretabilityについて)とDevSprintが開催され富士通の代表として参加しましたので、その様子を簡単にご紹介しようと思います。 なお、富士通はこのScikit-learnコンソーシアムにアジアから唯一参画している企業で、Scikit-learnの成長ならびにアジアでの浸透を推進しています。

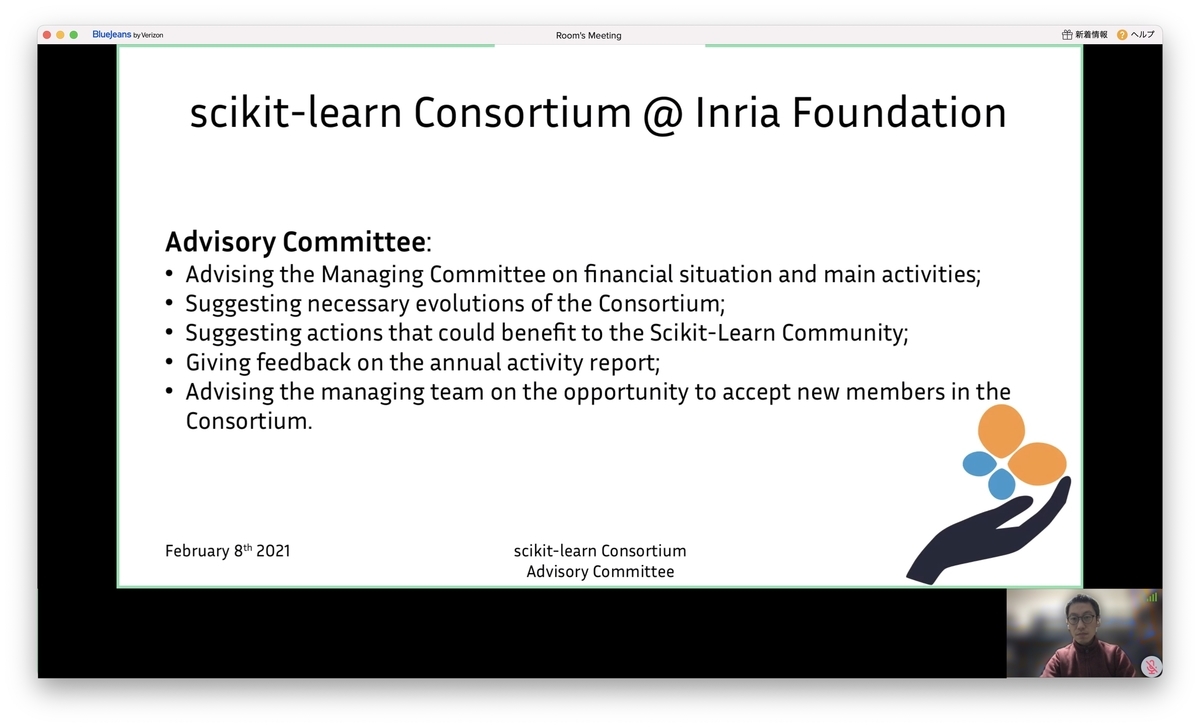

Advisory Committee (小橋)

ワークショップとDevSprintに先立ち、Advisory Committeeが開催されました。Advisory CommitteeではScikit-learnコミュニティが(方向性や財政の面において)健全に運営されるようにアドバイスするのが使命です。富士通からは小橋が代表と参加しており、他組織からの参加者と一緒に議論を行いました。

https://twitter.com/sklearn_inria/status/1361355579004977159

この中で富士通は「DevSprintの日本開催」を提案しています。DevSprintはもともとはOn-siteで開催されており、主に欧州を基準としたものでした。しかし、このCOVID-19の影響を受け、DevSprintもオンライン開催になっています(最後のOn-site開催はちょうど1年前にパリで行われ、小橋も参加しました)。オンライン開催になったため、日本からの参加に関し距離の問題はなくなりましたが、依然として時間の問題がのこっています。それを解決するための「DevSprintの日本開催」です。

この日本開催により、日本でのScikit-learnの更なる普及やコントリビューターの獲得などを目指していきたいと思っています。どうぞお楽しみにしててください!

Workshop (プライニング)

機械学習モデルの解釈可能性の重要性がますます高まる中、scikit-learnコンソーシアムは、解釈可能性に関する最近の開発と研究について話し合うために、DevSprintと共催でワークショップを開催しました。

ワークショップは2日間に渡って開催され、大企業や政府機関の機械学習グループのチームを含む、約30人の研究者と開発者が参加しました。講演では、scikit-learnの解釈可能性の一般的な理解、新しいライブラリの提示、そしてリアルワールド・アプリケーションの関係と実行を紹介されました。

(ワークショップはDiscord上で開催されました)

まず始めに、InriaとScikit-learnコンソーシアムのGaël Varoquauxによる歓迎と紹介のメッセージの後、Guillaume Lemaitre(Scikit-learnコンソーシアムスタッフ)は、scikit-learnのモデル検査の現状と制限について報告しました。 scikit-learnは、生成されたモデルの解釈可能性を検査するいくつかの方法をすでに提供しており、現在の制限を超えるための方向を模索しています。

次の講演では、BCGのJan Ittnerが、"FACET: a new open-source library for global model explanations"と題して、グローバルモデルの説明のための新しいオープンソースライブラリであるFACETを紹介しました。このライブラリは、MLモデルの機能の間の依存関係と相互作用を定量化するための新しいアルゴリズムを導入しています。これはscikit-learnのI/Fに準拠しており、人気のあるSHAPが提供しているような観測レベルの説明に加え、新しいグローバルな視点(特徴量同士の関係も含む)も説明します。

初日の最後の話は、AXAのClara Boveによる、"eXplainable AI Interfaces : a user perspective (ユーザーの観点から説明可能なAIインターフェース)"についてでした。Claraは、機械学習の研究者であると同時にユーザーインターフェースの設計者でもあり、自動車保険の例と価格の説明を使用して、専門家ではないユーザーに意思決定を(AIまたは統計で)説明する作業を発表しました。

2日目は、AXAのXavier RenardとThibault Laugielによる、"ML Interpretability vs. the 'Real Word'"の発表で始まりました。彼らの講演は、機械学習の解釈可能性の多くの分野、現在使用されているアルゴリズム、および様々な分野にわたるそれらの欠点を診断ツールにより乗り越えました。彼らは、この分野がまだ未成熟で意見の相違がある一方で、解釈可能性がAIのガバナンスと規制の台頭の重要な要因になるという、非常に明確な声明で話を締めくくっています。

次の講演は、フランス銀行のLaurent Dupontによるもので、"Explainability of ML in the financial sector"と題し、金融セクターにおけるMLの説明性を中心に、ガバナンスと規制における解釈可能性の重要性について、前の講演の声明を強調しました。 Laurentは、彼らのラボのいくつかの研究活動、特に金融商品や金融機関の独自の評価に機械学習を使用する方法、直面している未解決の質問、特にセクター規制への準拠と内部モデルの監査を確実にする方法を紹介しました。

ワークショップの最後の講演では、DataikuのLéo Dreyfus-SchmidtとSamuel Ronsinが、"A Causal Perspective On Interpretability Methods"と題して、解釈可能性の方法、特に機械学習モデルと因果干渉を使用する方法の誤用に対処する方法についての因果的視点を紹介しました。

DevSprint (プライニング)

ワークショップの後の2日間の開発スプリントでは、解釈可能性に関連する約30のIssueが検討されており、それらのほとんどにより、多くのプルリクエストがマージまたは現在検討されています。

scikit-learnコンソーシアムのメンバーとして、富士通グループの4人の研究者と開発者がワークショップと開発スプリントに参加し、マージされた5つのプルリクエスト(1, 2, 3, 4, 5)を送信しました。

ワークショップと開発スプリントはどちらも、解釈可能性の必要な進歩、修正と新機能の実用的な開発、および仮想環境でのメンバー間のチームワークの両方に関して大成功を収めています。

まとめ

富士通として今回のDev Sprintは通算3回目の参加であり、Scikit-learnのなかでもだんだん存在感が出てきたかな、という感触を持っています。

もしこんな富士通研究所に興味を持たれた方がいらっしゃいましたら、小橋がカジュアル面談を随時募集していますので是非コンタクトしてください!