こんにちは、Fujitsu Research of Europe Ltd.のJoe Townsendです。今日は、Fujitsu Kozuchi (code name) - Fujitsu AI Platform(以下Fujitsu Kozuchi)に搭載されているFujitsu Neuro-Symbolic Explainerについてご紹介します。

この記事は、5週連続集中連載の第2弾です。前回「AI 画像生成の特長のご紹介」はこちらです!

Fujitsu Neuro-Symbolic Explainerは、画像分類AIの分類結果に対して、分類した理由を説明する技術です。富士通が研究開発した先端AI技術を迅速に試すことができるプラットフォームFujitsu Kozuchiの、AIのコア技術単位のソフトウェア部品「AIコアエンジン」のひとつです。

画像分類AIは、例えば、入力された画像が都会の風景なのか、それとも田舎の風景なのか分類することができます。しかし、一般的に画像分類AIの振る舞いはブラックボックスで、なぜそのような分類結果になったのか理由を知ることはできません。この課題を解決するために、Fujitsu Neuro-Symbolic Explainerを開発しました。

*Neuro-Symbolicとは、ニューラルネットワークの学習能力と、シンボリックAI(ルールベースのAI)の説明可能性という特性を組み合わせる手法です。

Fujitsu Neuro-Symbolic Explainerの価値と利用イメージ

Fujitsu Neuro-Symbolic Explainerの価値は、AIが画像を分類した理由を知ることができるということです。

この技術を利用する場合には、まずAI開発者がこの技術を使って人が理解可能な分類ルールを作成します。AI利用者は、このルールを用いることで、画像の分類結果と共に分類の理由を得ることができます。

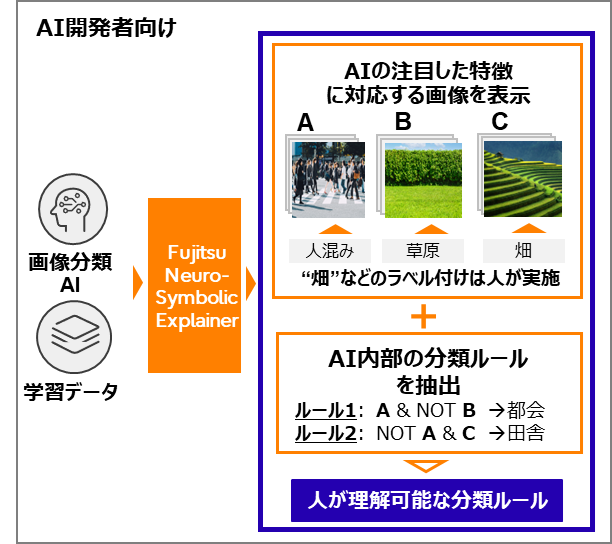

(1)AI開発者向けの価値と利用イメージ

AI開発者は、入力情報として、対象の画像分類AIモデルと、このAIの学習させる時に用いた学習データをFujitsu Neuro-Symbolic Explainerへ入力します。Fujitsu Neuro-Symbolic Explainerは、この入力情報を用いて、画像分類AIが画像を分類する過程で注目する特徴と、ルールを抽出します。

注目する特徴は、シンボルと呼ばれます。Fujitsu Neuro-Symbolic Explainerは各シンボルに対応した画像群を表示します。利用者のAI開発者は画像を見て、シンボルAは「人混み」、シンボルBは「草原」などのように、ラベル付けを行います。これを行うことで、画像分類AIが注目した特徴(シンボル)を人が理解できるものにします。

Fujitsu Neuro-Symbolic Explainerは、AI内部の分類ルールも抽出します。分類ルールとはシンボリックルールと呼ばれます。例えば、「ルール1:A & NOT B→都会」「ルール2:NOT A & C→田舎」「ルール3:・・・・」というようなものです。 この分類ルールと、上記でラベル付けしたシンボルにより、人が理解可能な分類ルール、例えば「人混み & NOT草原 → 都会」などを得ることができます。

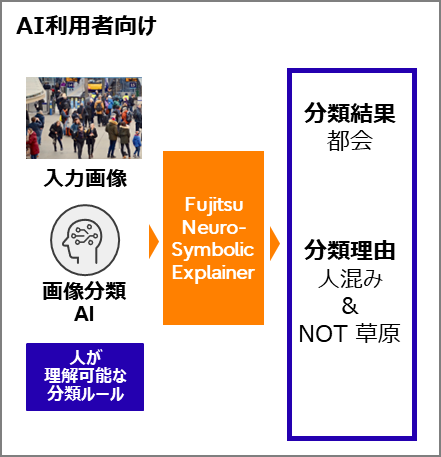

(2)AI利用者向けの価値と利用イメージ

AI利用者は、分類したい画像と、画像分類AIモデル、そして(1)で作成された「人が理解可能な分類ルール」を、Fujitsu Neuro-Symbolic Explainerへ入力します。Fujitsu Neuro-Symbolic Explainerは、画像の分類結果と、分類理由を出力します。以下の例では、AI利用者は、分類結果は都会であること、分類理由は「人混み」かつ「草原ではない」という理由によるもの、という情報を得ることができます。

Fujitsu Neuro-Symbolic Explainer の技術の特長

ひとつ目は、学習済みの画像分類AIを自動解析して、シンボリックルールを抽出することができる技術です。ブラックボックスであるAIが注目する特徴をシンボルとして抽出します。これらのシンボルは、文中の単語のようにシンボリックルールとして結合され、AIの動作を記述します。

シンボルとシンボリックルールを抽出するプロセスはカスタマイズ可能で、次のオプションを提供しています。

- 抽出されるシンボリックルールの長さ:説明を簡単にするためにルールを短く設定することができます。

- シンボリックルール抽出のためAIレイヤー:どの程度AIを深く見るかを選択できます。

ふたつ目は、シンボリックルールから説明可能な判断理由作成に必要な可視化情報の自動抽出技術です。シンボルが解釈可能になると、シンボリックルールが解釈可能になります。しかし、これらのシンボルに意味づけるラベリング処理は人間の操作が必要です。当社の技術は、シンボルを識別するために最も重要な情報のみを強調表示する対話型視覚化ツールを開発し、このラベリング作業を可能にしました。対話型視覚化ツールには以下のような特徴があります。

- 該当する特徴を含む画像と含まない画像を両方表示することで、特徴を明らかにします

- 画像において、特徴の場所を示す輪郭やヒートマップなどの視覚情報を表示します

開発者はこのような表示を見ながらラベリングすることができます。

Fujitsu Kozuchiで適用検証を始めませんか

このエンジンは、次のような課題解決を目指すAI開発者を対象としています。

- AIの認識結果とその理由も同時お客様に提供する:Fujitsu Neuro-Symbolic Explainerは、特に、医療、ADAS(先進運転支援システム)、社会システムなど、倫理的または安全性に重大な影響を及ぼす分野で、開発するAIソリューションの信頼性を高めます。

- AI開発プロセスの品質を強化する:Fujitsu Neuro-Symbolic Explainerは、AIの推論の欠陥(例えばバイアス)を明らかにし、これらの欠陥に対処できるようにします。

- AIに対する監査と規制に対応する:医療などの分野では、技術は厳しく規制されており、AIソリューションは説明可能性の欠如のために導入が難しいことが知られています。Fujitsu Neuro-Symbolic Explainerは、AIに対する監査、規制に必要なAI結果に対する説明の情報を提供します。

Fujitsu Neuro-Symbolic Explainer のご紹介デモやトライアル環境については、以下より、お問い合わせください。 お問い合わせはこちら